360度VR動画は、広視野角のレンズを備えた複数台のカメラによって、カメラを中心に前後左右と天地方向を記録した動画コンテンツです。近年においてはYouTubeやVimeoなどの動画投稿サイトやスマートフォンアプリなどで再生環境が整備され、エンターテイメント分野だけでなく、医療、観光、教育など幅広い領域での活用が始まっています。

視覚と聴覚によって空間を疑似体験できる新しいメディアとして注目が集まるVRですが、では実際に360度VR映像を制作するには、どのような機材や手順が必要なのでしょうか。「360度VR動画 メイキングワークフロー」(著・染瀬直人)では、撮影に必要な機材やソフトウェアをカバーしながら、360度VR動画の撮影から映像の合成、音声やテロップの編集、仕上げにいたるまで、一連の作業手順を網羅しています。

本記事では、Chapter1「360度VR動画の基礎知識」より、通常の映像制作との違いと、最も基本的なワークフローをご紹介します。

従来の動画制作より作業量が増大する360度の動画

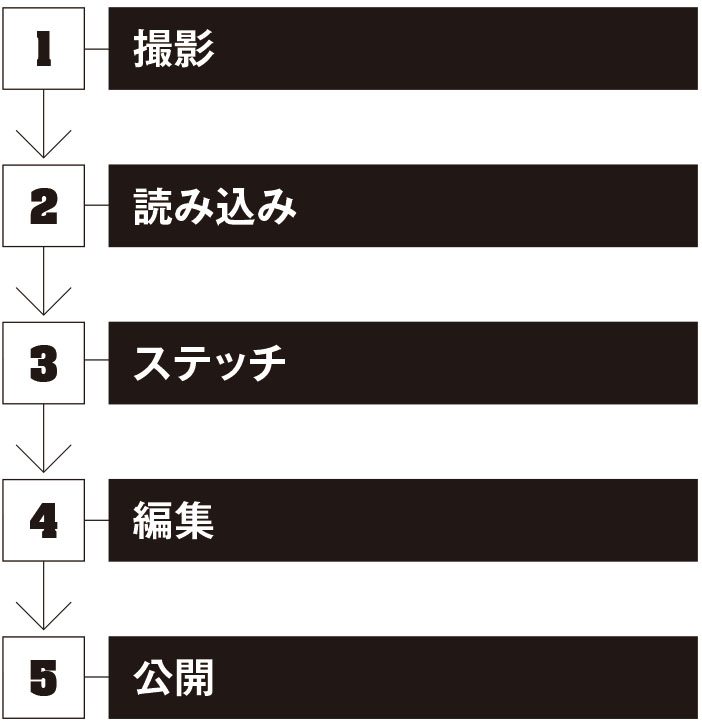

360度VR動画制作の基本的なワークフローは下表のとおり。従来の動画制作との決定的な違いは「ステッチ」という作業が発生する点である。これは複数のカメラで撮影した映像素材を1枚の全天球映像につなぎ合わせていく作業を意味する。このワークフローを眺めているだけでは、従来の動画制作と比較して、「ステッチ作業が追加されただけ」と感じられるかもしれない。しかし実際には、複数台のカメラを管理/操作する必要があり、撮影後の映像データもカメラの数だけ存在するため、ワークフロー全体を通して、360度VR動画制作のほうがはるかに労力がかかる。

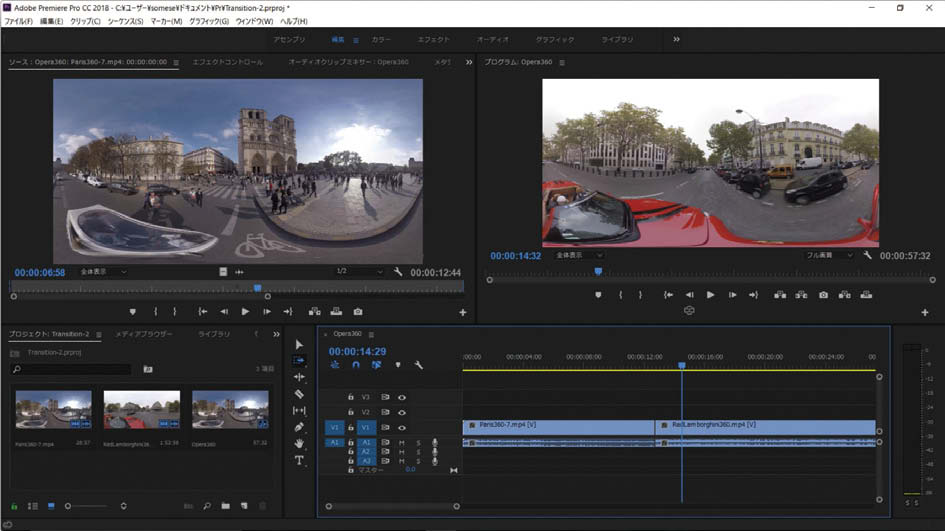

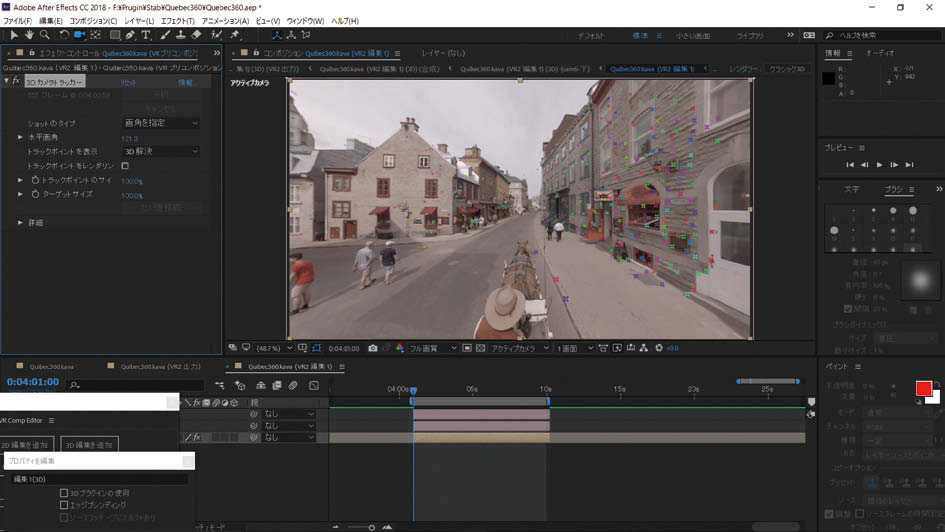

ステッチ後の映像素材については、通常の動画制作と同様、Premiere ProやAfterEffectsでポスプロ編集を行っていく。ただし、Adobe Creative Cloud 2018になって、よりVR機能が強化されているので、作業もしやすくなり、表現の幅も広がった。また、完成した360度VR動画をYouTubeなどに公開するには、メタデータを付加しなければならない。

1. 撮影:360度全方位に気を配りカメラはすべて同じ設定に

従来の動画撮影ではフレーミングと画面構成を考えて撮影をしてきたが、360度の撮影では全方位に気を配る必要がある。レンズを交換して寄り、引きを作るのではなく、被写体との距離や高さといったカメラの位置が重要となる。VRの撮影では、目あるいは胸の高さくらいで水平にカメラを設置するのが定説だ。また、カメラマンやスタッフが映り込んでしまうことも考慮しなければならない。後処理で映り込みを消す作業は手間がかかる。人物の被写体も視差や死角を避けるため、カメラから1mほど離れる必要がある。

一体型のVRカメラではない場合、あとで映像をシンクロさせるために撮影時に音や動きによる合図を入れておくことと、すべてのカメラの設定を同じにしておく必要がある。

2. 読み込み:複数の映像素材をナンバリングで管理

撮影した映像素材をステッチするためには、そのデータをパソコンにコピーして、ステッチングソフトに読み込ませる。

複数のカメラを使用している場合は、どのカメラで撮影をした映像素材かが後で区別できるように、それぞれのカメラと記録メディアに同じ数字を割り振っておくといい。プロ向けの定番VRカメラ「GoPro Omni」ならば、そのような作業も不要で専用ツール「GoPro Omni Importer」(Autopano Video Proに付属)で簡単にデータを読み込めたり、簡易的なステッチ作業ができたりする。

3. ステッチ:複数のカメラで撮影した映像を1つの360度動画に合成

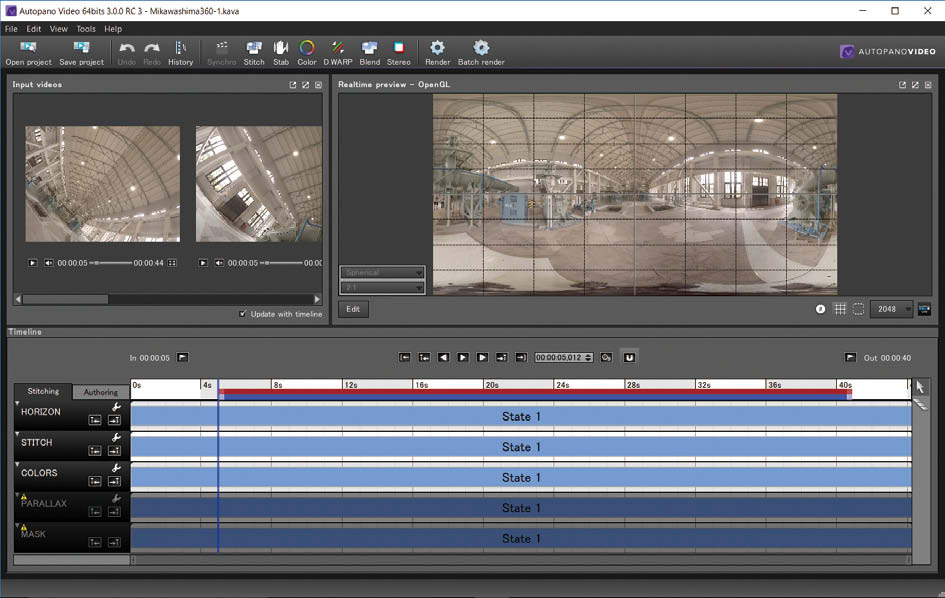

ステッチとは、複数のカメラやレンズで撮影した映像を、360度を表す2:1のエクイレクタングラーに合成するまでの作業のことを指す。

最近ではカメラ内でテンプレートやキャリブレーションによるリアルタイム・ステッチ処理が可能なVR専用カメラも存在するが、より精度の高いステッチを行うには仏Kolor GoPro社のAutopano Video Proなどのステッチングソフトを用いることが多い。サードパーティー製や自作のリグで複数台のカメラを使用して撮影した場合、まず映像の同期を行う。水平や視点の中心を調整したり、それぞれの映像で色調や明るさに差が出るためそれを整えたり、移動撮影の場合はブレを低減するためにスタビライゼーションを施したりしていく。さらに、3D VRならばステレオ設定をしたりして、作業を進めていくことになる。

最近では従来のコントロール・ポイントによるステッチだけではなく、オプティカル・フローといった新しい合成技術が注目を浴びている。

4. 編集:Premiere ProやAfter EffectsがVR対応

ステッチが完了したら、全天球の映像素材をPremiere Proなどの編集ソフトに読み込み、ポスプロ編集を行っていく。360度動画の素材自体は従来から通常の動画素材と同じように編集作業が可能であったが、エクイレクタングラーのままでは作業がしづらい。

2016年、Premiere Pro がVRに対応し、現在ではヘッドマウントディスプレイやYouTubeで視聴しているときのように、VR表示でプレビューしながら作業ができるようになった。しかし、テロップなどをそのまま挿入するとVRでプレビューしたときに歪んで見えたり、エフェクトを加えても均等に適用されな

かったりといった問題点もある。その場合はPremiere ProCC 2018 から標準搭載されたVR専用エフェクト「イマーシブビデオ」を用いて作業を行うことになる。

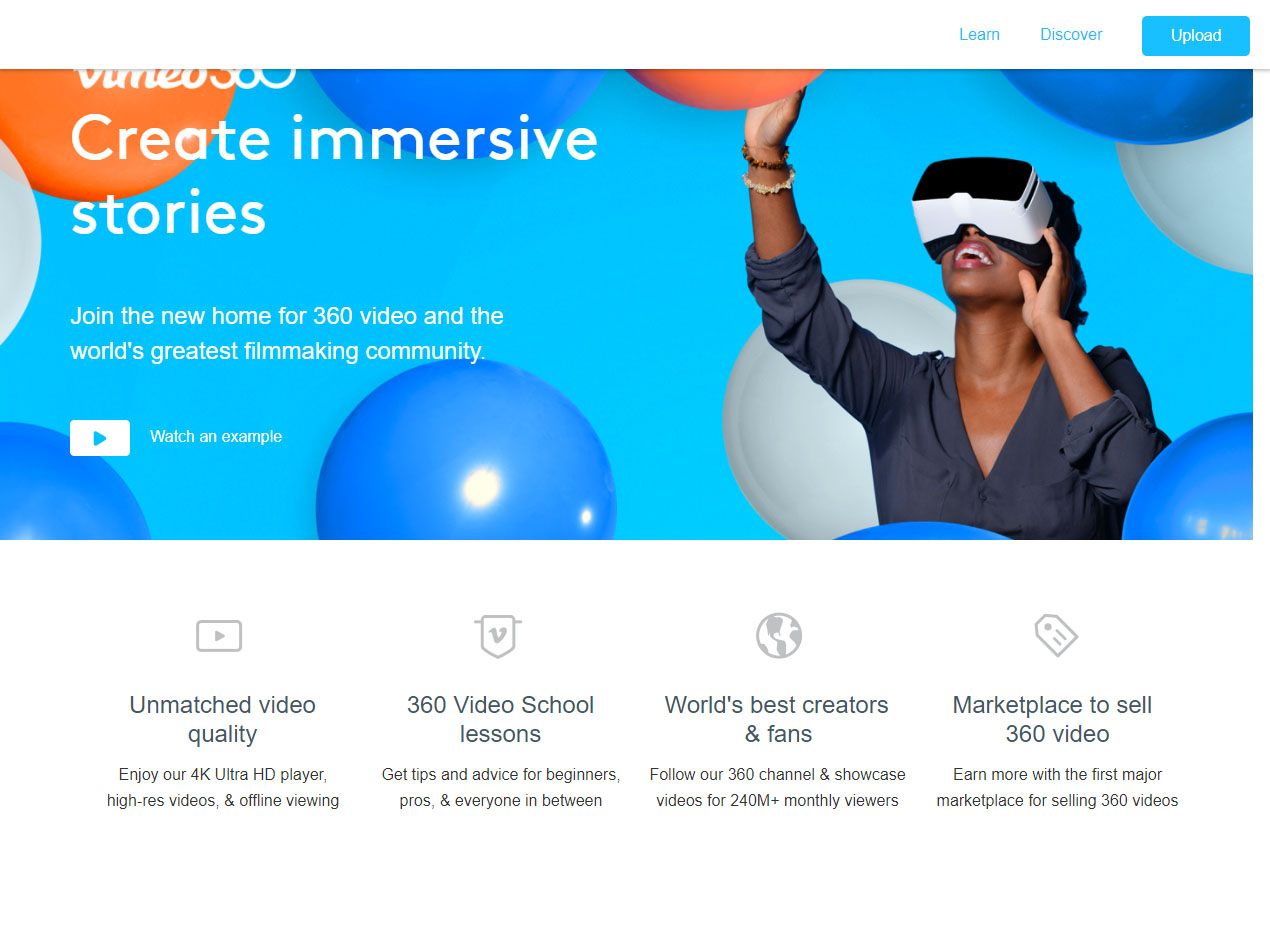

5. 公開:YouTubeやVimeoで世界に向けて作品公開

各VRゴーグルやVRカメラの独自プラットフォームに加え、最近ではYouTube やVimeoといった動画投稿サイトが360度動画に対応したことで、より手軽に作品を公開できる環境が整った。これらのサイトで作品を投稿する際には、メタデータを付加する必要がある。360度VR動画のデータは、それが「360度動画である」ことや「3D(立体視)である」こと、「空間音声を実装している」といった情報を埋め込むことで、YouTubeやVimeoといったサイトでインタラクティブに視聴したり、機能を反映させて再生ができるようになる。メタデータを追加するには、Premiere Proや「360 Video Metadata」というツールを利用する。

さらに、WebブラウザーだけでVRを実装する「WebVR」という技術を用いて自身のサイトに作品を公開する方法もある。すでにGoogle ChromeやFirefoxはWebVRに対応している。

<玄光社の本>